Pendant que certaines PME romandes annoncent leur "transformation IA" sur LinkedIn, leurs équipes corrigent des erreurs après les heures de travail. La vitrine est soignée. L'arrière-boutique, moins.

Ce n'est pas une coïncidence. C'est un mécanisme documenté.

Vous avez vu votre concurrent déployer Claude Code, Cursor, Perplexity Pro. Vous avez ressenti la pression. "Ils sont en avance. On prend du retard."

Voici ce que vous ne voyez pas.

Les corrections silencieuses. Le "référent IA" de l'équipe (s’il y en a un) qui relit tous les outputs. La direction qui confond volume produit avec valeur créée.

Vous regardez dans un miroir. Le miroir déforme.

L'IA ne plante pas les organisations. La confiance aveugle en l'IA le fait.

En 2023, He, Kuiper et Gadiraju testent 249 participants à l'Université de Delft [^ACM CHI '23 : ACM Conference on Human Factors in Computing Systems — la conférence de référence mondiale en interaction humain-machine. Organisée par l'Association for Computing Machinery, elle reçoit environ 10'000 soumissions par an pour un taux d'acceptation inférieur à 25 %. Une publication à CHI représente le plus haut niveau d'exigence du domaine. Site ACM CHI] avec une question centrale : sait-on vraiment travailler avec l'IA ?

Résultat contre-intuitif :

Les individus qui se croient les plus compétents avec l'IA sont ceux qui détectent le moins ses erreurs.

Ce n'est pas de la négligence. C'est l'effet Dunning-Kruger [^Effet Dunning-Kruger : Documenté par Kruger et Dunning à l'Université Cornell en 1999 (Journal of Personality and Social Psychology, 77(6)). Les individus peu compétents dans un domaine surestiment systématiquement leur niveau — ce qui diminue leur capacité à reconnaître leurs propres erreurs. DOI : 10.1037/0022-3514.77.6.1121], appliqué par He et al. à ce qu'ils nomment la reliance appropriée [^Appropriate reliance : Concept central en Human-AI Interaction. Désigne la capacité à accepter les outputs corrects de l'IA et à rejeter ses erreurs. Une reliance « inappropriée » signifie accepter les erreurs (over-reliance) ou rejeter les bonnes réponses (under-reliance). He et al. mesurent les deux formes — ce qui rend l'étude particulièrement pertinente pour le contexte PME, où les deux types de dérives coexistent.], soit la capacité à travailler avec l'IA sans lui faire une confiance aveugle.

Le mécanisme se déploie en quatre étapes.

Un collaborateur utilise Claude ou Cursor. Il produit plus vite. La satisfaction renforce sa conviction de maîtrise, et il cesse de vérifier. Il devient le “référent IA” informel de l'équipe. La charge de validation se concentre sur lui. L'organisation produit plus. Elle corrige plus. Elle paie plus d'heures. La valeur nette ne bouge pas.

Pendant ce temps, une PME concurrente observe ce volume. Elle ne voit pas les corrections. Elle voit un reflet. Elle panique. Elle adopte les mêmes outils, sans cadre. Le même cycle recommence.

Selon le McKinsey Global Institute (1'700 organisations, 2023) [^McKinsey Global Institute, 2024 : The State of AI in Organizations. Rapport annuel couvrant 1'700 entreprises dans 17 secteurs. 72 % déclarent avoir intégré l'IA dans au moins un flux opérationnel. Parmi elles, seulement 38 % ont formalisé un protocole de validation des outputs. Les organisations sans cadre de validation présentent un taux d'erreur 2,4 fois supérieur sur les tâches à fort enjeu métier. Source McKinsey], 62 % n'avaient aucun protocole de validation formel. Kahneman l'avait anticipé : 'La confiance subjective ne prédit pas l'exactitude du jugement.' [^Daniel Kahneman (1934–2024) : Psychologue et économiste comportemental, Prix Nobel d'économie 2002. Son ouvrage Thinking, Fast and Slow (Farrar, Straus and Giroux, 2011) formalise deux modes de pensée : le Système 1 (rapide, intuitif, source des biais) et le Système 2 (lent, analytique, source de la validation critique). L'IA opère précisément dans le Système 1 de l'utilisateur : elle produit une réponse en millisecondes, ce qui inhibe naturellement le réflexe de vérification. En savoir plus]

Le miroir déforme à l'échelle industrielle.

Deux organisations. Deux spirales. Une seule cause : personne ne mesure l'espace entre la confiance perçue et la compétence réelle.

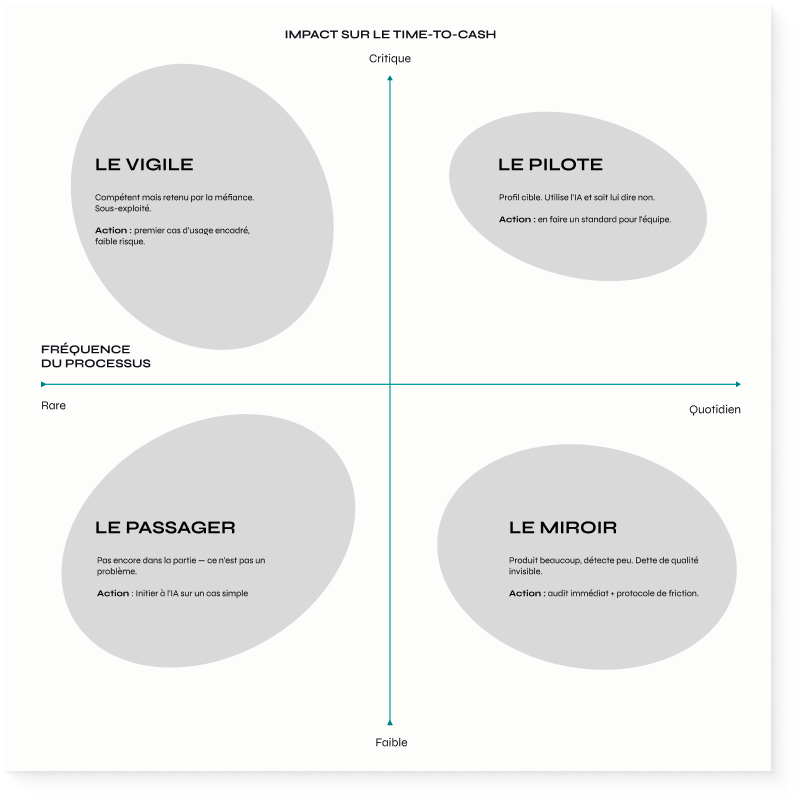

La Grille de Calibration : lequel de ces quatre profils est le vôtre ?

Avant de corriger une adoption IA qui dérive, cartographiez où se situe chaque collaborateur. Voici l'outil que j'utilise pour ouvrir le dossier dans une PME.

La Grille de Calibration croise deux axes comportementaux : le comportement face aux outputs IA (vérifie → fait confiance) et la capacité à détecter les erreurs (non entraîné → entraîné).

Outil — La Grille de calibration

Pour chaque membre de votre équipe IA, deux questions :

- Est-ce qu'il livre l'output directement — ou le vérifie d'abord ?

- Saurait-il repérer une erreur sans aide extérieure ?

Télécharger l'outil en A4

La question à poser à vos cinq utilisateurs IA les plus actifs :

"Montre-moi la dernière fois que tu as refusé ou corrigé une réponse de l'IA."

Si la question les surprend — vous avez votre diagnostic.

Si aucun ne se souvient d'un refus récent — votre équipe correspond au profil Le Miroir.

Batinord SA : quand le miroir a commencé à craquer.

Le profil Miroir Déformant n'est pas théorique. Voici à quoi il ressemble en entreprise.

Entreprise fictive — composite de cas observés dans des PME suisses de 80 à 150 employés.

Batinord SA. 110 employés. Secteur construction, Suisse romande. En janvier 2024, la direction déploie GitHub Copilot pour l'équipe technique et Claude pour les équipes en charge des devis. Le budget annuel alloué est de CHF 8'400, avec un objectif affiché de 20 % de gain de productivité.

Les trois premiers mois : volume de devis en hausse de 34 %. La direction est confiante. Thomas — technicien de 6 ans d'expérience — devient le référent informel. Tout le monde lui soumet ses outputs pour validation.

Du mois quatre au mois six, Thomas travaille le soir. Les devis contiennent davantage d'erreurs de marge. Personne ne fait le lien avec l'IA. La direction voit toujours le +34 %.

Au septième mois, un client signale une erreur de calcul dans un devis accepté. Perte directe : CHF 14'000. L'enquête révèle que Claude avait produit une estimation incorrecte. Thomas n'avait pas vérifié. Il s'était fié au miroir. Un signal était pourtant visible : le temps entre la réception de l'output IA et l'envoi du devis était passé de quelques heures à quelques minutes. Personne ne l'avait lu.

Le vrai coût : CHF 14'000 de perte directe. 180 heures de corrections non facturées sur six mois. Surcharge concentrée sur une personne. ROI négatif sur l'investissement IA.

Pendant que la direction célébrait les 34 % de volume, la valeur nette s'érodait en silence.

Ce qui a changé : un protocole simple. Tout devis IA passe par une relecture à froid de cinq minutes par un second regard. Le taux d'erreur a chuté.

Thomas était épuisé parce que son IA travaillait bien. C'était le même problème.

Les 3 pièges que le miroir vous cache.

Batinord aurait pu éviter les 180 heures et les CHF 14'000. Trois angles morts ont rendu le miroir invisible.

Piège 1 — Mesurer l'adoption, pas la validation.

Le premier KPI qu'on me montre dans une PME suisse : le nombre d'utilisateurs actifs sur les outils IA. Il mesure la confiance, pas la compétence. Pendant que vous comptez les connexions à Claude Code, le taux de correction réel reste invisible.

Le bon indicateur : combien de fois votre équipe refuse un output IA par semaine.

Un second signal, encore plus silencieux : le temps entre l'output IA et la livraison. Un vérificateur ralentit. Un Miroir envoie dans la foulée.

Piège 2 — Former vos équipes à l'utilisation de l'IA, pas à ses limites.

La majorité des formations IA enseignent à mieux prompter. Aucune ne traite la détection d'erreurs. C'est l'inverse du besoin réel.

Gary Klein, lors d'une étude sur 600 décisions d'experts en situation réelle (MIT Press, 1998), concluait : 'Ce qui distingue l'expert du novice, ce n'est pas la vitesse — c'est la capacité à détecter l'anomalie avant de valider.' [^Gary Klein : Psychologue cognitiviste américain, fondateur de la Naturalistic Decision Making (NDM). Son étude Sources of Power (MIT Press, 1998) analyse 600 décisions de pompiers, médecins urgentistes et officiers militaires en conditions réelles. Conclusion centrale : les experts agissent sur des signaux faibles d'anomalie — ils ne comparent pas toutes les options, ils identifient ce qui cloche. Ce mécanisme est ce que la formation IA classique n'enseigne pas. En savoir plus]

Un tutoriel de vingt minutes sur cinq erreurs réelles de Claude Code vaut plus que trois heures sur les fonctionnalités. La recherche de Delft le confirme : ce qui recalibre la confiance, c'est l'exposition aux failles [^Intervention de calibration — He et al., 2023 : Un tutoriel de 15 minutes présentant des cas réels d'erreurs de l'IA (sur N=249 participants) réduit l'over-reliance de manière statistiquement significative. L'effet est mesurable dès la première session. Ce résultat valide une approche simple et peu coûteuse, applicable dans n'importe quelle PME sans budget de formation dédié.]. Pas la maîtrise des outils.

Piège 3 — Centraliser la validation sur votre "expert IA".

Le référent informel est votre risque principal. Il absorbe la charge de toute l'équipe. Il développe une surconfiance structurelle. Il devient le vecteur du miroir déformant dans l'organisation.

La validation doit être un réflexe distribué. Pas le rôle d'une personne. Quand Thomas part en vacances, le miroir ne doit pas se fissurer.

Une question. Cette semaine. Avant tout le reste.

Avant d'acheter de nouvelles licences. Avant de lancer une formation. Avant de redéfinir vos process.

Posez cette question à vos cinq utilisateurs IA les plus actifs :

"Montre-moi la dernière fois que tu as refusé ou corrigé une réponse de l'IA. Pourquoi tu ne lui faisais pas confiance ?"

Si la question les surprend — vous avez votre réponse.

Les trois actions qui en découlent :

- Audit de validation — demandez à votre équipe d'exporter leurs historiques Claude ou Cursor de la semaine. Comptez le ratio outputs acceptés / outputs corrigés. C'est votre baseline.

- Session "erreurs IA" — montrer à votre équipe trois exemples réels d'erreurs produites par Claude ou Cursor dans votre secteur. Pas pour créer de la méfiance. Pour recalibrer le miroir.

- Protocole de friction — ajouter un checkpoint de validation sur les outputs IA à fort enjeu (devis, contrats, communications client). Cinq minutes de relecture. Pas de validation automatique.

La règle d'or

Ne mesurez pas combien vos équipes produisent avec l'IA.

Mesurez combien elles refusent, corrigent et standardisent.

C'est là que la valeur se construit : entre la confiance et la compétence.

Vous n'avez pas besoin de plus d'IA.

Vous avez besoin du bon angle.

Celui qui fait gagner du temps sans faire exploser l'équipe.

Si vous voulez trouver votre angle d'intégration IA sans imploser, prenons 25 minutes.

On cartographie ensemble votre Grille de Calibration.

Source et méthodologie

L'illusion de compétence dans la collaboration humain-IA

- Type d'étude : Étude expérimentale contrôlée, N=249 participants, sur des tâches de classification avec assistance IA.

- Méthodologie : Les participants ont réalisé des tâches de classification en deux conditions — avec et sans assistance IA. Leur niveau d'auto-évaluation de compétence était mesuré avant chaque session. La variable dépendante principale est la reliance appropriée : capacité à accepter les bons outputs et à rejeter les erreurs. Une intervention de calibration (tutoriel de 15 minutes exposant des erreurs réelles de l'IA) a été testée comme levier correctif.

- Recherche : He, G., Kuiper, L., & Gadiraju, U. (2023). Knowing About Knowing: An Illusion of Human Competence Can Hinder Appropriate Reliance on AI Systems. CHI '23, Delft University of Technology. Source

Référence fondatrice

- Kruger, J., & Dunning, D. (1999). Unskilled and Unaware of It: How Difficulties in Recognizing One's Own Incompetence Lead to Inflated Self-Assessments. Journal of Personality and Social Psychology, 77(6), 1121–1134. Cornell University. DOI : 10.1037/0022-3514.77.6.1121